理想MindVLA-o1基础模型相比上一代有哪些变化,与小鹏VLA 2.0有什么不同?

3月17日,理想汽车发布了下一代自动驾驶基础模型MindVLA-o1,这不仅仅是一个自动驾驶模型,也是一个正在逐渐进化的物理世界基础模型。那么,它相比上一代有哪些变化?与小鹏VLA2.0又有什么不同?

理想智驾技术架构的演进

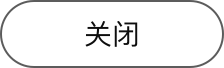

在2023年之前,行业主流的智驾系统基本都是基于规则的系统架构,在这一阶段包括两类方案:一类是Map-Lite轻图方案,另一类是Mapless无图方案。轻图方案快速实现了智驾可用区域的扩展,从轻图到无图,先验信息完全去除,感知能力实现了统一,形成了两段式的架构,但中间依然加入了很多人类的先验策略。很多智驾方案的城市NOA量产系统都是在这样的架构基础上不断迭代和泛化。

而2024年开始,理想汽车在中国率先量产了端到端+VLM智驾双系统架构,在这一架构中,理想汽车是用一段式端到端模型来完成驾驶决策。同时,结合VLM语义理解,让系统能够更好的理解复杂场景和语义信息,而这一步是智驾系统第一次真正具备了跨场景、跨任务的理解能力。

从端到端+VLM到VLA的架构变化

到了2025年,理想汽车进一步将端到端模型与VLM进行了深度融合,形成了VLA智驾系统。在这个VLA系统中,语义理解、语言交互、逻辑推理以及驾驶决策被统一整合到了一个新的模型框架中。在训练方法上,VLA从传统的模仿学习逐步引入了强化学习,让模型在仿真环境中持续训练,能够不断的提升自我优化和泛化。

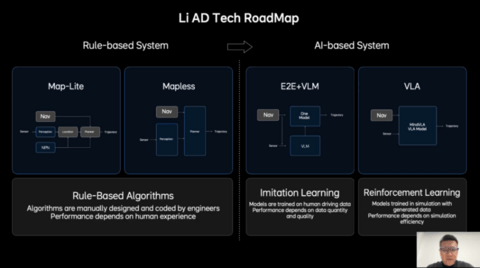

在2024年量产的系统中,理想汽车采用了端到端+VLM双系统架构,在这个架构中端到端模型负责快速驾驶决策,VLM模型负责更高层次的语义理解和推理,两者通过接口进行协作,通常把这种模式理解为快思考和慢思考的组合系统。

但是这种双系统架构存在着一些问题:空间理解、语言理解和行为决策仍然在不同的模型中进行交互和对齐。

因此,从2025年开始,理想汽车将这些能力统一到了同一个模型框架中——VLA模型。

在VLA的架构下,视觉信息首先被编码成了一个3D空间的token,语言理解由大模型进行推理,最终由统一的Action Policy(行动决策)生成驾驶轨迹。也就是说,空间理解、语言理解和行为决策被统一到了同一个模型的不同模块中。在系统架构的角度来看,这意味着智驾系统引入了语言思考的部分。而引入语言思考后带来了三个非常关键的问题。

第一个是3D空间、语言思考和行为之间存在对齐效率不够理想的问题。

在智驾系统中,模型需要同时完成三件事情,理解3D空间、进行语音层面的思考和推理、输出具体的驾驶行为轨迹。如何让这三个过程在同一个隐空间中高效对齐,是一件非常困难的事。

如果对齐的不够好,就会出现两类问题:第一,语义理解和行为出现了偏差。模型能够理解场景,但最后生成的轨迹并不符合预期。第二,决策延迟。视觉、语言、行动之间的传递链路过长,导致反应速度下降。

比如,当车辆前方出现了一个行驶较慢的车辆时,系统不仅需要理解这个场景,还要快速推理,是立即变道,还是持续跟随,而且变道的时候,速度应该如何控制?如果空间理解、语言推理和行为决策的对齐效率不够高,最后生成的轨迹可能就并不是最优的。因此需要提升3D空间理解能力,让语义和行为之间对齐精度和整体推理效率提升。

第二个是长尾场景的问题,在智驾中很多关键问题都来自极少发生的长尾场景,仅仅依靠真实数据的规模扩展,很难覆盖这些场景,需要结合合成数据,还有强化学习。通过仿真环境进行大规模的训练,才能让系统真正具备泛化能力和鲁棒性。

第三个是计算效率和系统成本问题。VLA模型往往包含大规模的语言能力,这会带来非常高的计算和内存开销。在车端系统中,如何在有限的计算资源下运行VLA,是非常现实的问题。理想汽车认为,未来的方向必须是软硬协同的架构设计。通过联合优化模型架构、推理系统以及硬件能力,才能让VLA真正在车端规模化落地。

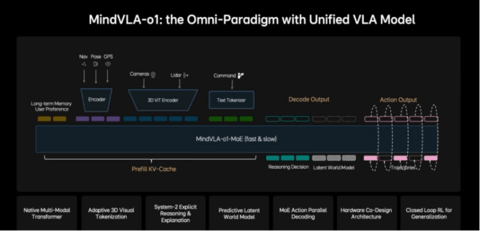

因此,为了解决这些问题,理想汽车提出了下一代统一架构MindVLA-o1。MindVLA-o1是一个统一范式的VLA架构模型。它围绕着5个核心的设计原则来构建。

第一,它具备原生多模态的MoE Transformer架构。MindVLA-o1是一个原生多模态的Transformer。所谓原生多模态指的是模型设计之初,就统一将视觉、语言、行动三种模态进行训练,而不是像传统的模型一样,分别进行不同模态的训练,再在后期进行组合,这种设计可以让模态在同一个表示空间中共同训练和对齐,从而获得更高的效率和更强的泛化能力。

第二,原生3D的视觉tokenizer。这个设计的关键是3D视觉的空间编码能力,引入了3DViT Encoder,用于对真实世界三维结构进行直接建模。与传统方法不同,它并不是简单的将2D图像和3D信息进行拼接,而是在编码阶段之间构建3D的空间表示,这使得模型能够更加自然的理解真实的物理世界的空间结构。

第三,多模态的推理能力。除了视觉之外,依然保留了语言能力。语言模型在系统中承担了几个关键的角色,语义理解、常识知识、交互能力。同时在模型中引入了“系统2”的显示推理能力,使模型在复杂的场景中进行更深层次的决策分析。

第四,隐式世界模型。通过Predictive Latent Word Model这个模块,模型可以对未来的环境状态进行预测。也就是模型不仅仅能理解当前环境,还能在隐空间中模拟未来发生的可能情况,这个能力对于自动驾驶的决策非常关键。

第五,软硬件协同设计和强化学习的闭环能力。在架构设计之初,进行了软硬件协同的设计,使得模型在车端计算资源下高效运行。

同时,整个系统采用了统一的MoE架构,非常适合闭环强化学习的训练。通过强化学习,模型可以在训练中不断优化策略,持续提升方法能力。

MindVLA-o1系统是如何看的?

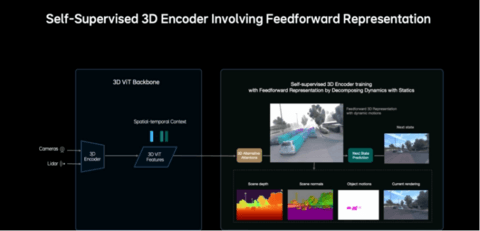

在自动驾驶中一个核心的问题是系统必须真正的理解三维物理世界,而不仅仅是2D图像。因此,MindVLA-o1系统设计了一个自监督的3DViT Encoder(3D视觉编码器)。

在训练过程中,同时利用视觉和激光雷达的数据,这两种模态天然具备空间的对齐关系。激光雷达提供了准确的三维几何信息,视觉提供了丰富的语义信息。然后通过自监督训练,模型可以在同一个表示空间中同时学习几何结构和语义信息。

而且在训练中引入了前馈的3DGS表示,在这个框架中,将场景分为了两个部分:静态环境用稳定的3DGS进行建模,动态环境单独建模其运动状态。这样模型不仅能够理解当前场景,还能预测未来的状态变化。在这个训练过程中,还使用了下一帧预测作为自监督的信号,同时也学习了深度信息、语义结构与物体运动等等。

MindVLA-o1系统是如何思考的?

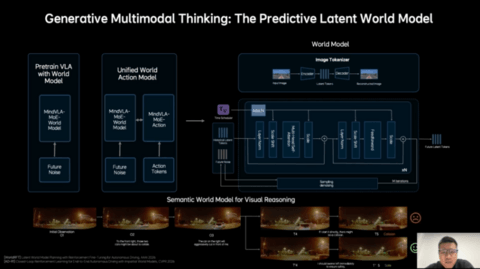

在很多复杂的驾驶场景中,自动驾驶不仅需要理解当前环境,还需要预测未来可能发生的事情。人类在做决策时其实也是这样,当我们看到一个场景时,大脑不仅会理解当前的画面,还会在脑海中想象未来可能发生的情况。

比如,当我们看到右侧有一辆车准备并线时,系统需要进行推理,这个车是否会切入当前的车道。如果它真的并线了,我们应该如何避让?是减速、是刹车还是向左变道。

而为了做出更好的决策,系统必须能够预判未来几秒的场景变化。为了让模型具备这种能力,MindVLA-o1系统引入了预测式的隐式世界模型。它的核心思想是让模型在隐空间中模拟未来。如果直接生成未来真实的图像,计算成本会非常高。

首先会把当前的视觉输入编码成一组latent tokens,作为当前场景的一个紧凑的表征,然后Word model会基于这些token预测未来的latent状态。通过这种方式,模型可以在隐空间中高效的模拟未来场景的演化过程。

MindVLA-o1系统是如何生成驾驶轨迹的?

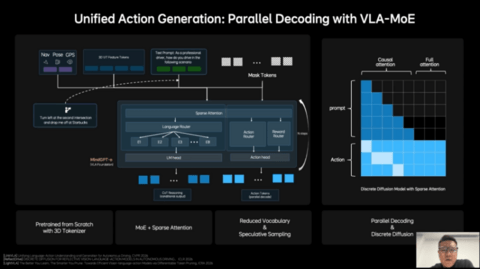

MindVLA-o1设计了Unified Action Generation模块。这个模块的核心部分,是使用了VLA-MoE架构,不同于传统的通用语言模型的MoE,它引入了专门负责行动的Action Expert, 这些动作专家会从多个输入中提取关键信息,比如3D场景的特征、导航目标、驾驶指令,以及前面提到的多模态的推理思考,将其整合专注于生成高精度的驾驶轨迹。可以把它理解为在这些系统中,有一组经验丰富的驾驶专家,专门负责把复杂的认知转化成具体的行动。

为了满足智驾的实时性要求,理想汽车没有采用传统的自回归的生成方式。传统模型需要一个一个点的生成轨迹,而是采用了Parallel Decoding,也就是说所有轨迹点可以同时并行生成,大幅提升了轨迹的生成效率,尤其是在长时距的轨迹预测时。

那么并行生成轨迹如何保证质量呢?为此理想汽车还引入了Discrete Diffusion的优化方案,模型会通过N步的迭代,不断对轨迹进行refine(改进),这有点类似于逐步去噪的过程。

最终,理想汽车得到的轨迹在空间上连续、在时间上稳定,同时也能满足车辆动力约术。因此,这一套轨迹生成的机制可以总结为三点,MoE保证了生成的专业性,Parallel保证了生成的速度,Diffusion保证了生成的轨迹精度。

MindVLA-o1系统是如何进行持续进化的?

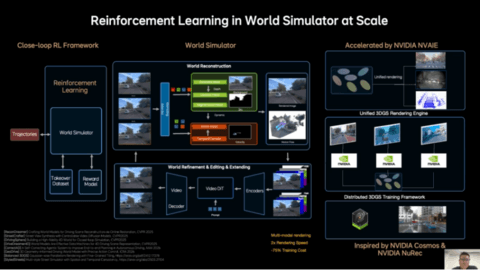

在传统的自动驾驶系统中,模型主要依赖于模仿学习。从人类的驾驶数据中持续学习,但这样的过程有一个明显的限制,模型只能在已经存在的数据中探索,而鲁棒性大大降低。为了突破这一点,理想汽车构建了一个闭环强化学习的框架。在这个框架中,模型不仅可以从真实数据中学习,还可以在Word Simulator中不断探索和优化。也就是说,系统可以在模拟环境下不断尝试新的策略,根据反馈进行策略更新。

MindVLA-o1与小鹏VLA2.0又有什么不同?

小鹏VLA 2.0:去语言层、纯端到端物理世界大模型,视觉→隐式表征→连续动作,完全抛弃显式语言转译,视觉直接生成驾驶动作。而理想MindVLA-o1:保留语言层,视觉→语言理解→动作,但将视觉、语言、行动三种模态统一进行训练,而不是像传统的模型一样,分别进行不同模态的训练,在后期再进行组合,这种设计可以让模态在同一个表示空间中共同训练和对齐。这是本质的区别。

在决策方式上,小鹏VLA 2.0靠物理世界因果推理,直接输出方向盘、油门、刹车连续控制,动作丝滑、无顿挫。而理想MindVLA-o1靠视觉和语言对齐后并行决策,更稳定。